”自监督学习“ 的搜索结果

自监督学习(Self-supervised Learning)是机器学习的一种形式,它在监督学习和无监督学习之间架起了一座桥梁。自监督学习不依赖于传统意义上的标记数据,而是从输入数据本身生成监督信号来训练模型。这种方法允许...

自监督学习(Self-Supervised Learning) Self-Supervised Learning. 自监督学习(Self-Supervised Learning)是一种无监督表示学习方法,

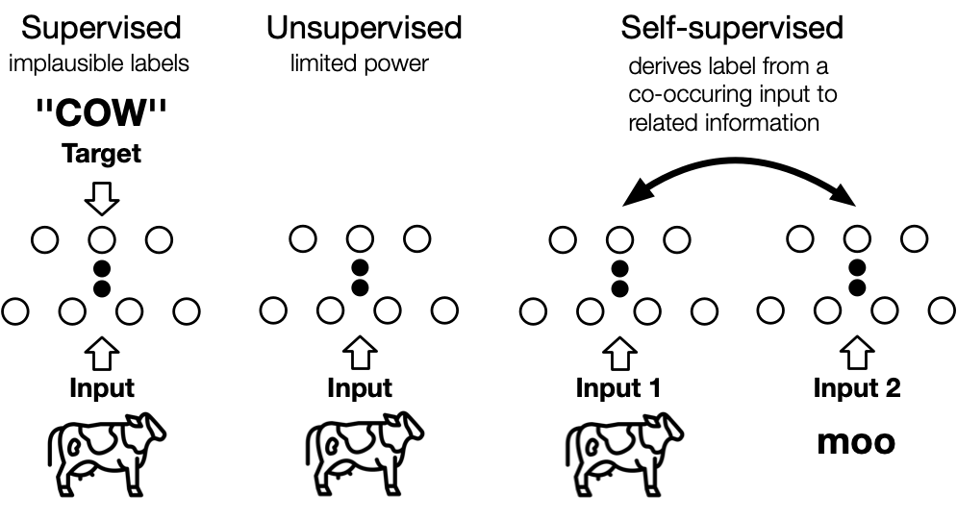

自监督学习是可以看做是一种特殊的无监督学习的一个子类别(但并非无监督学习),因为它利用了未标记的数据。

半监督或弱监督混淆:(半监督和弱监督)指的是在数据集中部分一些例子X没有标签,但是数据的人工标签是存在的。

作者:禅与计算机程序设计艺术。

注:其实现在很多论文里对自监督和无监督已经不做区分。

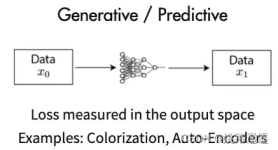

监督学习: 所有数据都有标签或真值,直接对网络输出结果和标签计算loss函数,进行训练。 缺点:标签很难获取,且提取的特征依赖于标签(即特定任务),而不是数据本身的特征 无监督学习: 所有数据都没有标签,通过...

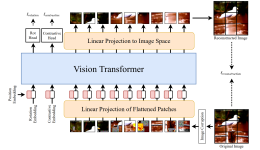

对比学习一般是自监督学习的一种方式 什么是自监督学习 自监督学习主要是利用辅助任务(pretext)从大规模的无监督数据中挖掘自身的监督信息,通过这种构造的监督信息对网络进行训练,从而可以学习到对下游...

机器学习中有几个带有“监督”二字的名词,易混淆,写篇博客解释一下下~

自监督学习-MoCo-论文笔记

标签: 深度学习

和无监督学习不同,自监督学习主要是利用辅助任务(pretext)从大规模的无监督数据中挖掘自身的监督信息,通过这种构造的监督信息对网络进行训练,从而可以学习到对下游任务有价值的表征。 换句话说:自监督学习的...

推荐文章

- 阿里云企业邮箱的stmp服务器地址_阿里云stmp地址-程序员宅基地

- c++ 判断数学表达式有效性_高考数学大题如何"保分"?学霸教你六大绝招!...-程序员宅基地

- 处理office365登录出现服务器问题_o365登陆显示网络异常-程序员宅基地

- Nginx RTMP源码分析--ngx_rtmp_live_module源码分析之添加stream_ngx_rtmp_live_module 原理-程序员宅基地

- 基于Ansible+Python开发运维巡检工具_automation_inspector.tar.gz-程序员宅基地

- Linux Shell - if 语句和判断表达式_shell if elif-程序员宅基地

- python升序和降序排序_Python排序列表数组方法–通过示例解释升序和降序-程序员宅基地

- jenkins 构建前执行shell_Jenkins – 在构建之前执行脚本,然后让用户确认构建-程序员宅基地

- 如何完全卸载MySQL_mysql怎么卸载干净-程序员宅基地

- AndroidO Treble架构下HIDL服务查询过程_found dead hwbinder service-程序员宅基地