”模型压缩“ 的搜索结果

PaddleSlim是一个专注于深度学习模型压缩的工具库,提供低比特量化、知识蒸馏、稀疏化和模型结构搜索等模型压缩策略,帮助开发者快速实现模型的小型化。

基于bert的中文分类实现,具体包括模型训练,分类预测,模型压缩,模型部署等环节

深度学习模型的压缩和加速是指利用神经网络参数的冗余性和网络结构的冗余性精简模型,在不影响任务完成度的情况下,得到参数量更少、结构更精简的模型。被压缩后的模型计算资源需求和内存需求更小,相比原始模型能够...

向AI转型的程序员都关注了这个号????????????机器学习AI算法工程 公众号:datayx目前在深度学习领域分类两个派别,一派为学院派,研究强大、复杂的模型网络和实验方法,为了...

目录总结低秩分解定义特点1.二元分解2.多元分解参考文献 深度学习模型的压缩和加速是指利用神经网络参数的冗余性和网络结构的...利用神经网络的冗余性进行深度学习的模型压缩和加速引起了学术界和工业界的广泛兴趣,各

threejs优化之3D模型压缩(gltf-pipeline,采用draco压缩算法)

文章目录总结参数共享定义特点1.循环矩阵2.聚类共享3.其他方法参考文献 深度学习模型的压缩和加速是指利用神经网络参数的冗余性和网络结构的...利用神经网络的冗余性进行深度学习的模型压缩和加速引起了学术界和工业

很棒的深度模型压缩 深度模型压缩相关研究论文,文章,教程,库,工具等的有用列表。 当前,回购协议是附加的给定标签,即[Pytorch / TF]。 要在您常用的框架中快速找到动手的Repos,请按Ctrl + F开始 :grinning_...

深度学习模型计算复杂度高,参数存在冗余。(1)线性或非线性量化。 (2)结构或非结构剪枝。 (3)网络结构搜索。 (4)权重矩阵的低秩分解。(蒸馏)优化精度、性能、存储等,使得可以在一些场景和设备上进行相应...

数据高效的模型压缩 这个 repo 是数据高效模型压缩的 Pytorch 实现。 背景 已经进行了许多尝试,以将在高端 GPU 服务器上取得的卷积神经网络 (CNN) 的巨大成功扩展到智能手机等便携式设备。 因此,在云端提供深度...

模型压缩策略源代码.zip

标签: 软件/插件

模型压缩策略源代码.zip

实用的3D模型压缩方法

标签: 前端

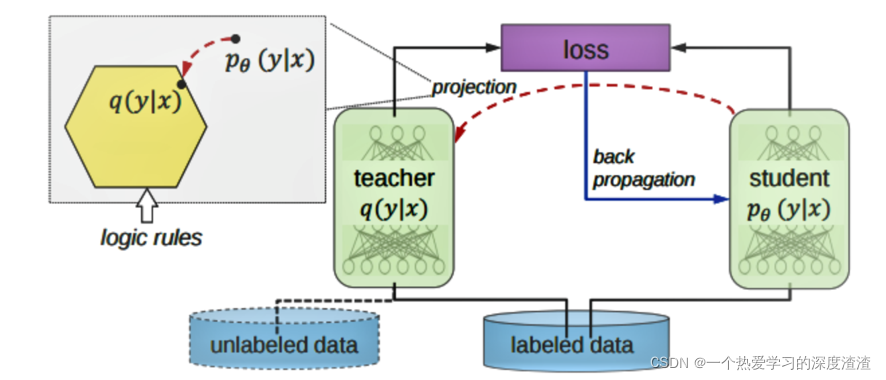

A: 提出了一种通用的面向Transformer-based预训练模型压缩方法:MiniLM。MiniLM有3个核心点: (1)蒸馏teacher模型最后一层Transformer的自注意力模块 (2)在自注意模块中引入值之间的点积 (3)引入助教模型辅助模型...

1,CNN模型压缩综述 1 模型压缩的必要性及可行性 (1)必要性:首先是资源受限,其次在许多网络结构中,如VGG-16网络,参数数量1亿3千多万,占用500MB空间,需要进行309亿次浮点运算才能完成一次图像识别任务; ...

很棒的ML模型压缩 很棒的样式列表,可列出最佳的机器学习模型压缩和加速研究论文,文章,教程,库,工具等。 欢迎公关!内容工具图书馆构架影片会谈培训与教程 文件 一般的深度神经网络的模型压缩和加速研究将模型...

本文集中了一些针对模型压缩和技巧,用于加快计算速度的论文。 如下所示,模型压缩具有不同的技术,在这里我将主要列出深度学习网络部分。 1. Review papers,综述文章 以下是推荐用于模型压缩和加速的几篇论文。 ...

作者:禅与计算机程序设计艺术 深度学习模型通常具有...模型压缩有两种主要方式:剪枝(Pruning)和量化(Quantization)。下面将详细介绍这两种方法。 剪枝(Pruning)是指修剪网络中不需要的连接(即权重),通过

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地