”对比学习“ 的搜索结果

https://segmentfault.com/a/1190000037592155

在前面几篇文章中,我们已经介绍了高性能Python遗传和进化算法框架——Geatpy的使用及一些案例。 https://blog.csdn.net/qq_33353186/article/details/82014986 ... https://blog.csdn.net/qq_33...

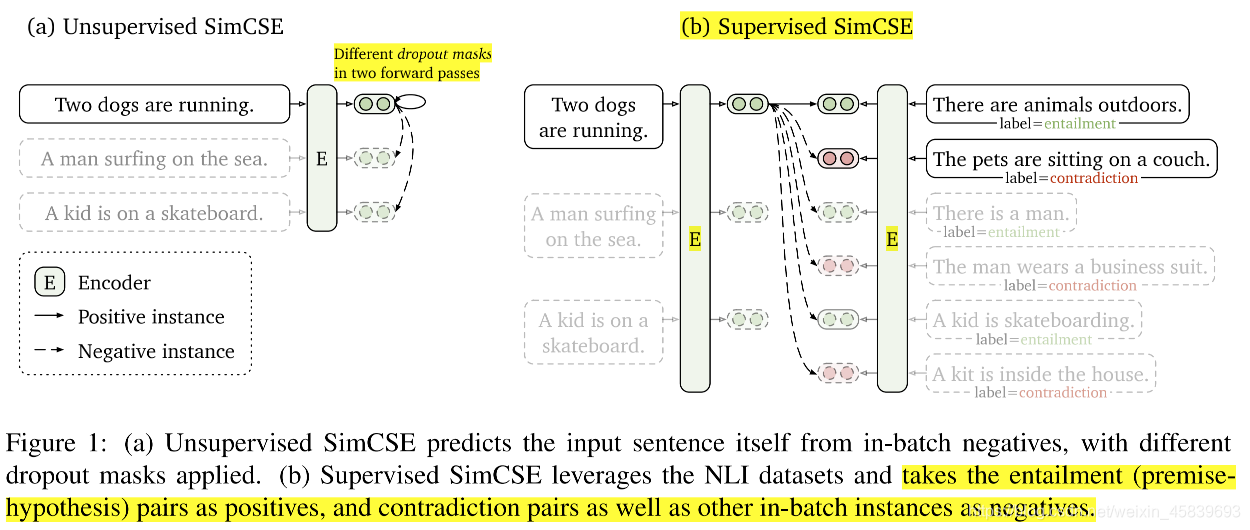

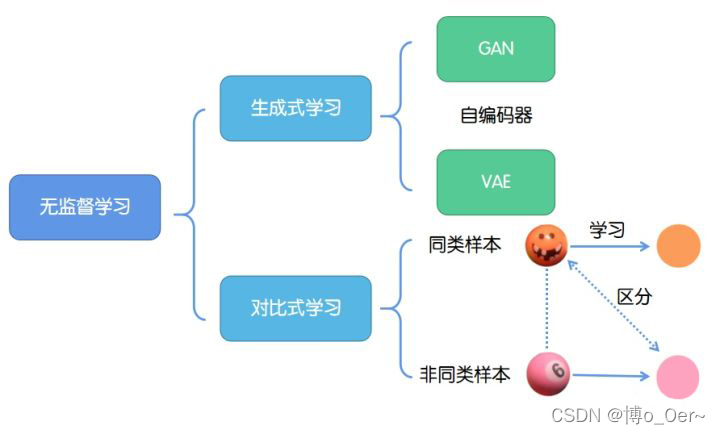

读文章笔记(十一):对比学习(Contrastive Learning)对比学习 来源于:对比学习(Contrastive Learning):研究进展精要 对比学习 对比学习属于无监督或者自监督学习,但是目前多个模型的效果已超过了有监督模型...

本文介绍了最近流行的对比自监督学习。

大代码时代的到来使得目前有很多工作开始利用无监督学习,来通过大量的代码数据学习到通用的预训练模型,然后再针对不同的下游任务对预训练模型进行微调。这些预训练模型对不同的下游任务有比较强的泛化性,并且得到...

来自:SUFE AI Lab“ 对比学习是一种自监督学习方法,近年来在图像、文本、语音等领域都取得了惊人的效果,得到了广泛的关注和研究,针对对比学习框架的机理探索也在不断进行中。本文对几篇经典对比学习模型和原理...

例如:随着人工智能的不断发展,机器学习这门技术也越来越重要,很多人都开启了学习机器学习,本文就介绍了机器学习的基础内容。 提示:以下是本篇文章正文内容,下面案例可供参考 一、pandas是什么? 示例:pandas...

作者想解决什么问题?获取更好的时间序列表征。作者通过什么理论/模型来解决这个问题?通过dropout实现序列instance level的采样,相较于以往的切片采样方式,更加完整的保留了序列信息。提出了一个Bilinear ...

Contrastive Language-Image Pre-training,简称CLIP,即对比学习语言-图像预训练模型

1 研究背景; 2 关键卖点; 3 主要架构; 4 损失函数; 4.1自监督对比学习损失; 4.2 有监督对比学习损失; 5 模型性能; 参考文献;

总的来说,对比损失和infoNCE损失都是有效的对比学习方法,可以用于无监督学习任务。选择使用哪种损失函数取决于具体的任务和模型结构,以及对样本相似性度量的需求。对比损失(contrastive loss)和信息最大化非...

模仿学习对比强化学系 模仿学习 优点: 1.简单、稳定的监督学习过程 缺点: 1.需要提供榜样行为数据 2.需要处理多解型行为(例如 绕过障碍物,可以从左边或者右边,但是专家数据不一定覆盖所有行为,可以用多元高斯...

参考文章: 1、YOLOv5 深度剖析 2、如何看待YOLOv8,YOLOv5作者开源新作,它来了!? 3、anchor的简单理解 YOLO v8的Head 部分相比 YOLOv5 改动较大,换成了目前主流的解耦头结构,将分类和检测头分离,同时也从 ...

达梦数据库

给定一个源文档D和一个参考摘要Sˆ,抽象摘要模型f的目标是生成候选摘要S = f(D),以便它获得由评估度量M分配的最高分数m = M(S, Sˆ)。 在这项工作中,我们将整体生成过程分为两个阶段,其中包括: ...

Lucene与SQL对比学习,适用于新手

对比学习可以通过自我监督的方式捕捉时间序列数据中的时间依赖性和动态变化,这使得它特别适合处理时间序列数据,因为时间序列的本质特征就在于其随时间的演变和变化。因此,相较于传统的时序,能够适应更广泛、更...

监督学习、半监督学习、无监督学习、自监督学习、强化学习和对比学习

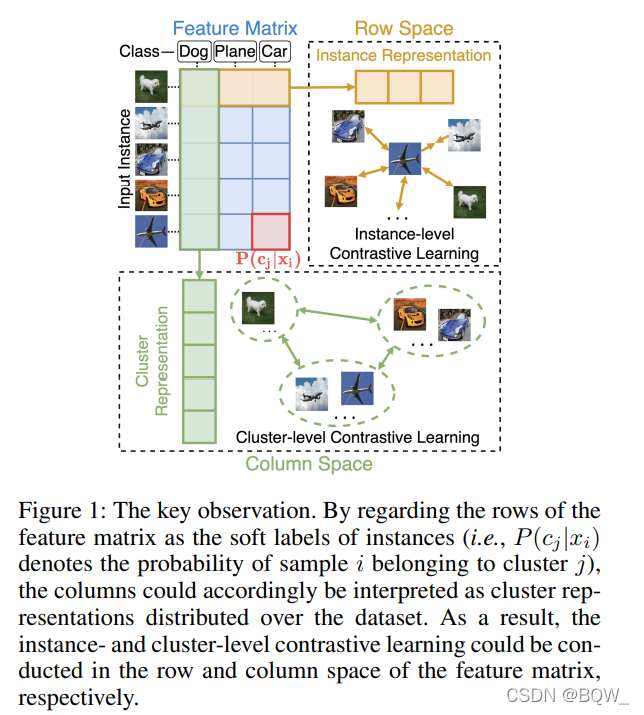

文章目录Contrastive Clustering文章介绍问题背景拟解决问题联合优化的应用主要贡献相关工作对比学习深度聚类实例级和聚类级的含义提出的方法模型结构PCB模块ICH模块CCH模块算法流程损失构建实验数据集介绍实验结果...

随着对比学习(Contrastive Learning)在 CV、NLP 等领域大放异彩,其研究热度近年来也逐步走高。在图学习领域,由于图(Graph)数据也存在缺少标签或难以标注的问题,自 2020 年来,研究者们也着力于将对比学习技术...

首先介绍下为什么下一代神经网络需要无监督对比学习。目前整个人工智能行业的落地,其实都依赖于监督学习模式,无论是OCR、ASR、TTS、ImageDetection,如果没有大量的标注,是很难训练出商业化程度的模型的。这个...

论文阅读笔记(10):A Simple Framework for Contrastive Learning of Visual Representations,用对比学习进行视觉表达的简单框架摘要简介方法对比学习框架 摘要 本文介绍了SimCLR:一个简单的视觉表征对比学习...

`华为团队发表于ICSE’23`的 CoLeFunDa:Explainable Silent Vulnerability Fix Identification《CoLeFunDa:可解释的静默漏洞修复识别》 ... 分享重点突出,对流程图介绍清晰,比直接看论文更容易理解 ...

机器学习 机器学习简单来说就是让机器进行自我学习,举个例子作为学生的我们经常参加考试,考试在考场上遇到的题目我们未必做过,但是在考试之前我们会刷很多的题目,通过刷题总结解题方法,这样上了考场也能以不变...

对比聚类 《Contrastive Clustering》 论文地址:https://www.aaai.org/AAAI21Papers/AAAI-1352.LiY.pdf 一、简介 聚类作为最基础的无监督学习算法之一,其能在不使用任何标签的情况下将样本分组到不同的簇。由于...

为了使事情变得实用,我们将研究监督式对比学习(SupCon),它是对比学习的一部分,而后者又是度量学习的一部分,但稍后会介绍更多。 通常如何进行分类 在进行度量学习之前,首先了解通常如何解决分类任务。 卷积...

Contrastive Learning,对比学习的一些理论概念博主已经在上篇文章整理了,传送门:Contrastive Learning(对比学习,MoCo,SimCLR,BYOL,SimSiam),本篇文章想整理几篇博主最近看到的比较有代表性的应用论文,话...

一些废话: 之前读完了MAE,对自监督学习有了新的认知。 当初在看半监督学习时,发现MeanTeacher、semiGan也好,...自监督学习可以粗略分为:基于上下文、基于对比的、基于时序这三种。 入门可以阅读这篇博客:自监

深度学习 检测模型对比

对比学习:将样本通过模型映射到特征空间,在特征空间中拉近同类的样本,并使得不同类的点排斥开。 2.代理任务 代理任务:学到一个好的数据表征,生成一个自监督的信号充当Ground Truth,作为标签。 个体判别,...