加入对比学习的语义相似度计算Similarity.zip

”对比学习“ 的搜索结果

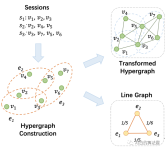

1.交叉熵loss和对比loss区别 交叉熵 loss 是 最后结果过一层 fc 然后进行 softmax 。 然后 fc 的系数 W 就是特征的模板(模板的意思是把一些特征用这个Wc参数转换后,就能判断它是否是c类,相当于这个Wc就是c类的...

ranking loss实际上是一种metric learning,他们学习的相对距离,而不在乎实际的值. 其应用十分广泛,包括是二分类,例如人脸识别,是一个人不是一个人。 在不同场景有不同的名字,包括 Contrastive Loss, Margin ...

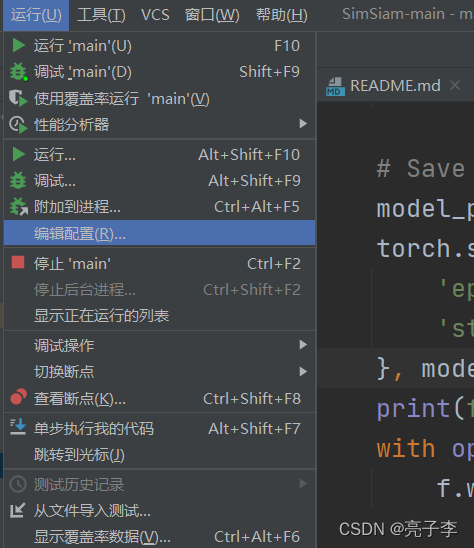

文 | Happy源 | 极市平台本文是FAIR的陈鑫磊&何恺明大神在无监督学习领域又一力作,提出了一种非常简单的表达学习机制用于避免表达学习中的“崩溃”问题,从理论与实验角度证...

同学们发现没有,对比学习在我们的日常工作生活中已经很常见了,比如推荐系统任务,为用户推荐相似的商品或预测用户的购买行为;又比如图像检索,为用户找相似图片或识别不同物体。另外还有语音识别、人脸识别、NLP...

对比学习的核心思想是在无监督的情况下,学习出能够区分正例和负例的特征表示。对于一个给定的数据样本,正例是来自与该样本相似的其他样本,而负例是与该样本不相似的样本。通过最大化正例之间的相似度,同时最小化...

自监督学习:生成和对比方法综述

标签: 自监督学习

自监督学习作为一种新的学习方法,近几年在表征学习方面取得了骄人的成绩,其利用输入数据本身作为监督,并使得几乎所有类型的下游任务都受益。

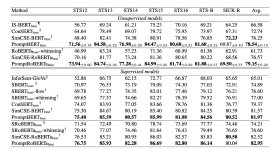

在NeuraIPS上对比学习(Contrastive Learning)...本文为大家奉上NeurIPS 2020必读的七篇对比学习相关论文——对抗自监督对比学习、局部对比学习、难样本对比学习、多标签对比预测编码、自步对比学习、有监督对比学习。

留个坑hhh

文章目录对比学习 Contrastive Learning Contrastive Learning在CV领域风生水起,涌现了一批非常优秀的成果,例如:针对ImageNet有Google的SIMCLR, Facebook的MoCo, 和强化学习的CURL。在音频领域却少有研究。 最近...

作为机器学习的新宠,对比学习给CV、NLP、推荐系统领域都带来了极大的福音,在图像识别、语音识别、自然语言处理等现实场景中的无监督学习任务中起到了非常重要的作用,自然也成为了各大顶会争相投稿的热门方向。...

点击下方卡片,关注“CVer”公众号AI/CV重磅干货,第一时间送达本文转载自:AIWalker标题&作者团队paper:https://arxiv.org/abs/2104.00...

推荐文章

- 阿里云企业邮箱的stmp服务器地址_阿里云stmp地址-程序员宅基地

- c++ 判断数学表达式有效性_高考数学大题如何"保分"?学霸教你六大绝招!...-程序员宅基地

- 处理office365登录出现服务器问题_o365登陆显示网络异常-程序员宅基地

- Nginx RTMP源码分析--ngx_rtmp_live_module源码分析之添加stream_ngx_rtmp_live_module 原理-程序员宅基地

- 基于Ansible+Python开发运维巡检工具_automation_inspector.tar.gz-程序员宅基地

- Linux Shell - if 语句和判断表达式_shell if elif-程序员宅基地

- python升序和降序排序_Python排序列表数组方法–通过示例解释升序和降序-程序员宅基地

- jenkins 构建前执行shell_Jenkins – 在构建之前执行脚本,然后让用户确认构建-程序员宅基地

- 如何完全卸载MySQL_mysql怎么卸载干净-程序员宅基地

- AndroidO Treble架构下HIDL服务查询过程_found dead hwbinder service-程序员宅基地