”对比学习“ 的搜索结果

自监督学习主要是利用辅助任务从大规模的无监督数据中挖掘自身的监督信息来提高学习表征的质量,通过这种构造监督信息对网络进行训练,从而可以学习到对下游任务具有价值的表征。 辅助任务(pretext): 可以认为是...

负样本质量分析 Cai T T, Frankle J, Schwab D J, et al. Are all negatives created equal in contrastive instance discrimination?[J]. arXiv preprint arXiv:2010.06682, 2020. 最简单的 95% 的负样本是不必须...

成对图像和文本中医学视觉表征的对比学习 创新点: 只需要10% ImageNet的labeled data就能达到同样的或者更好的效果 模型解释: 提出了ConVIRT模型——一个通过利用图像和文本数据的自然配对来学习visual ...

点上方蓝字视学算法获取更多干货在右上方···设为星标★,与你不见不散仅作分享,不代表本公众号立场,侵权联系删除转载于:新智元继MoCo和SimCLR之后非监督学习的又一里程碑!Sa...

在本文中,提出了一种新的基于对比学习的对比正则化(CR)方法,将模糊图像和清晰图像的信息分别作为负样本和正样本来利用。CR保证了恢复后的图像在表示空间中向清晰图像拉近,向远离模糊图像的方向推远。此外,考虑到...

唯一的区别是,在cross entropy loss里,k指代的是数据集里类别的数量,而在对比学习InfoNCE loss里,这个k指的是负样本的数量。温度系数τ虽然只是一个超参数,但它的设置是非常讲究的,直接影响了模型的效果。

这里我们介绍一篇对比学习的综述文章。对比学习是最近非常热门的自监督表示学习方法,在很多的下游任务上都达到或超过了ImageNet预训练的效果。本文比较系统地总结了目前对比学习的几个常用的方法。文章地址:...

在二分类任务中,对比学习损失可以用来学习区分正负样本的特征表示。损失函数有多种,其中比较常用的一种是InfoNCE loss。InfoNCE Loss损失函数是基于的一个损失函数,是由NCE Loss损失函数演变而来。

本文介绍3种对比学习损失函数,包含RINCE/ReLIC/ReLICv2。

对比学习是自监督的一种,现在很火。自监督属于无监督的一种,即没有标记数据,相当于 cluster 聚类来判断物体类别(所以在label少的时候,unsupervised learning可以帮助我们学到data本身的high-level information...

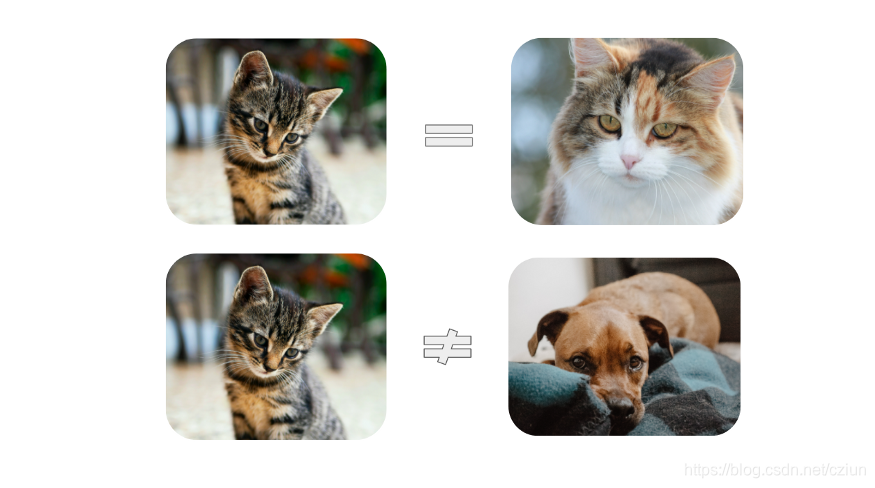

对比学习可以说是自监督版本的度量学习,最大的的特点是自监督的,也就是自动构造正例的方法。SimCLR是对比学习的典型例子(对比损失函数InfoNCE来驱动达成对比学习的目标:正例拉近,负例推远) 容易发生模型坍塌...

SimCLS框架进行`两阶段抽象摘要` ,其中Doc、S、Ref分别表示文档、生成摘要和引用。 在`第一阶段`,使用Seq2Seq生成器(BART)生成候选摘要。...评分模型通过对比学习进行训练,其中训练示例由Seq2Seq模型提供。

推荐文章

- 机器学习之超参数优化 - 网格优化方法(随机网格搜索)_网格搜索参数优化-程序员宅基地

- Lumina网络进入SDN市场-程序员宅基地

- python引用传递的区别_php传值引用的区别-程序员宅基地

- 《TCP/IP详解 卷2》 笔记: 简介_tcpip详解卷二有必要看吗-程序员宅基地

- 饺子播放器Jzvd使用过程中遇到的问题汇总-程序员宅基地

- python- flask current_app详解,与 current_app._get_current_object()的区别以及异步发送邮件实例-程序员宅基地

- 堪比ps的mac修图软件 Pixelmator Pro 2.0.6中文版 支持Silicon M1_pixelmator堆栈-程序员宅基地

- 「USACO2015」 最大流 - 树上差分_usaco 差分-程序员宅基地

- Leetcode #315: 计算右侧小于当前元素的个数_找元素右边比他小的数字-程序员宅基地

- HTTP图解读书笔记(第六章 HTTP首部)响应首部字段_web响应的首部内容-程序员宅基地