”对比学习“ 的搜索结果

近两年来,对比学习在图像领域大火,在NLP领域也出现了一些利用对比学习的工作。对比学习的一般思想是构造正样例(与原样例语义相似的样例)和负样例(与原样例语义不相似的样例),通过设计对比损失函数,缩小语义...

有的paper将对比学习称为自监督学习(Self-supervised learning),有的将其称为无监督学习(Unsupervised Learning , UL)。自监督学习是无监督学习的一种形式。自监督学习(Self-supervised learning)可以避免对...

论文阅读笔记_CCSSL

对比学习13篇文章综述学习笔记

Contrastive Learning for Label Efficient Semantic Segmentation 在同一图片内,相同种类的像素应该接近,不同种类的像素应该远离;鼓励像素根据其标签分成不同的簇。 在不同的图片间,引入额外的正例,即为来自...

本文对其中的推荐系统论文 Simple Yet Effective Graph Contrastive Learning for Recommendation 一文进行解读。论文可在公众号后台回复 ICLR-2023-RecSys 获取,所有论文都是按照该方式存档。...

在深度学习中, 如何利用大量、易获取的无标注数据增强神经网络模型的特征表达能力, 是一个具有重要意义的研究问题, 而对比学习是解决该问题的有效方法之一, 近年来得到了学术界的广泛关注, 涌现出一大批新的研究方法...

©作者 | 高帆学校 | 北京邮电大学研究方向 | 计算机视觉随着 Transformer 的提出以及在底层任务上应用的进一步探索,相信在很多底层任务数据集上可以取得新的 SOTA 成绩。...

1.对比学习一般泛式 其中x+是和x相似的正样本,x-是和x不相似的负样本 score是一个度量函数,来衡量样本间的相似度。 如果用向量内积来计算两个样本的相似度,则对比学习的损失函数可以表示成: 其中对应样本x有1个...

对比学习的核心思想是吸引正样本对,排斥负样本对。对比学习在无监督(自监督)表征学习中广泛应用。基于孪生网络的简单高效的对比学习实例方法已经被开发出来。实际上,对比学习方法从大量的负样本的获益,InfoDist...

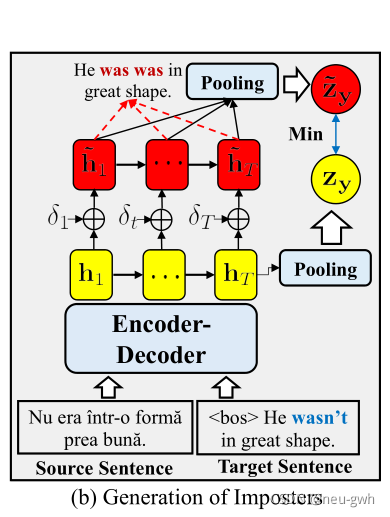

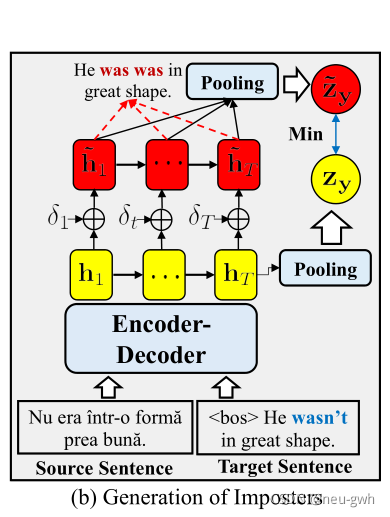

每天给你送来NLP技术干货!来自:FudanNLP论文链接:https://aclanthology.org/2021.emnlp-main.22.pdf论文代码:https://gith...

对比学习文献介绍,包含TS2vec、Subseries Consistency、TLoss/ Subseries Consistency、TNC/ Temporal consistency等文献,以及其他对比学习文件

对比学习的概念很早就有了,它是无监督学习的一种方法,但真正成为热门方向是在2020年的2月份,Hinton组的Ting Chen提出了SimCLR,用该框架训练出的表示以7%的提升刷爆了之前的SOTA,甚至接近有监督模型的效果。...

《Supervised Contrastive Learning》论文阅读笔记

在将图像表示和文本表示通过一个多模态编码器融合之前,ALBEF首先...作者从理论上和实验上验证了所提出的图像-文本对比学习和动量蒸馏的有效性。与现有的方法相比,ALBEF在多个下游V+L任务上有更好的性能和更快的速度。

本文提出了一个有监督的对比学习(MER-Supcon)的微表情识别框架,其主要目的是提取微表情的关键特征,并克服不相关的面部运动引起的噪音。首先,提出了一种新的双终端微表情采集策略,并应用于获得光流图,旨在扩大...

第二种方法是最近比较火的基于对比学习的图文匹配训练方法,利用图像和其对应的文本描述,采用对比学习的方法训练模型。这两种方法各有优劣,前者可以达到非常高的图像识别精度、比较强的迁移能...

对比学习综述.rar

点击下方卡片,关注“CVer”公众号AI/CV重磅干货,第一时间送达作者丨小马转载自丨极市平台导读作者专为目标检测任务“量身定制”了对比学习框架DetCo,在PASCAL VOC数据集上...

对比学习这两年在自监督学习、无监督学习任务中非常火,取得了非常优秀的性能。这个工作就是想办法将其用在监督学习任务中,在训练过程中更有效地利用标签信息。 文章研究的点主要在于对比学习在分类任务中的应用 ...

对比学习是无监督表示学习中一种非常有效的方法,核心思路是训练query和key的Encoder,让这个Encoder对相匹配的query和key生成的编码距离接近,不匹配的编码距离远。想让对比学习效果好,一个核心点是扩大对比样本...

自监督的对比学习中,一个样本对应着data augmentation一个正样本和多个负样本,以往的关于对比学习的研究中,也是热衷于不断增加负样本的数量来提高模型的表征能力;有监督的对比学习,将同一类

SSL 中使用的最古老和最受欢迎的技术之一是对比学习,它使用“正”和“负”样本来指导深度学习模型。此后,对比学习得到了进一步发展,现在被用于完全监督和半监督的环境中,并提高了现有技术水平的性能。现在让我们...

1)在基于CL的推荐模型中,CL的损失是核心,而图的增强只起次要作用。(2)优化CL损失可以得到更均匀的表示分布,能在推荐...(3)通过在表示中加入有向随机噪声,进行不同的数据增强和对比,可以显著提高推荐能力。...

基于对比学习的目标检测预训练方法梳理

对比学习的基本源理,包括损失函数及其超参数的设置。

基于对比学习的聚类算法SCCL 一、简介 无监督聚类算法的目标是基于表示空间的距离度量来发现数据中的语义类别; 近期聚类研究主要集中在将深度学习和聚类集成在一起,这些方法尽管对聚类有所改善,但在具有大量簇的...

对比损失比较好理解,在输入的多模态数据中使得相同对应样本的相似度越大越大,不对应样本的相似度越小越好。

NLP中的一些对比学习工作

作者丨parasol@知乎 (已授权)来源丨https://zhuanlan.zhihu.com/p/521614413编辑丨极市平台导读本文通过解读对比学习的经典论文和综述,介绍对比学习的概念,主流方法和优势。对于不同方法的算法设计和实验结果,...