”对比学习“ 的搜索结果

对比学习一般是自监督学习的一种方式 什么是自监督学习 自监督学习主要是利用辅助任务(pretext)从大规模的无监督数据中挖掘自身的监督信息,通过这种构造的监督信息对网络进行训练,从而可以学习到对下游...

对比自监督学习 英文原文 对比自监督学习 导读 利用数据本身为算法提供监督。 对比自监督学习技术是一种很有前途的方法,它通过学习对使两种事物相似或不同的东西进行编码来构建表示。 自监督方法将取代深度学习中...

对比学习损失函数中超参数温度temperature(tao)的作用

文 | 花小花Posy大家好,我是小花。对比学习的大火???? 越来越旺了,已然从CV蔓延到NLP了。今天给大家介绍的正是一篇将对比学习应用到文本聚类上的工作,NAACL21新鲜出炉的pa...

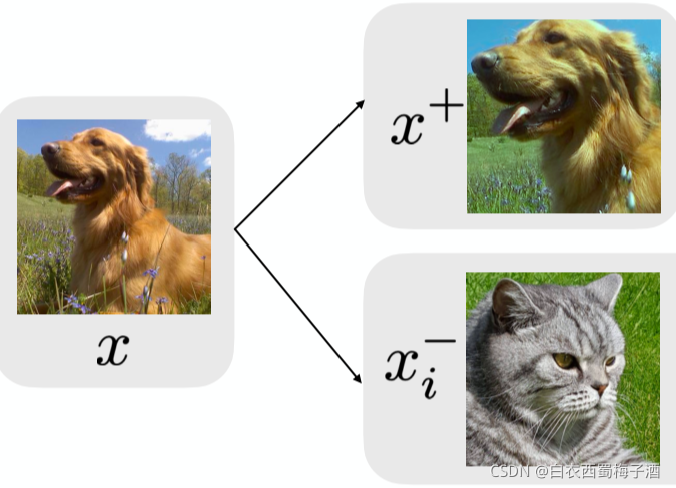

如何才能为对比性学习提供好的负面例子?我们认为,就像度量学习一样,表征的对比性学习得益于硬性负面样本(即难以与锚点区分的点)。使用硬阴性样本的关键挑战是,对比性方法必须保持无监督状态,这使得采用现有的...

Pytorch实现有监督对比学习损失函数关于对比损失Pytorch实现有监督对比损失END 关于对比损失 无监督对比损失,通常视数据增强后的图像与原图像互为正例。而对于有监督对比损失来说,可以将同一batch中标签相同的视为...

这是对比学习&自监督学习(含视频资料&PDF资料),文字分析讲解已经在博客中记录。

推荐文章

- 机器学习之超参数优化 - 网格优化方法(随机网格搜索)_网格搜索参数优化-程序员宅基地

- Lumina网络进入SDN市场-程序员宅基地

- python引用传递的区别_php传值引用的区别-程序员宅基地

- 《TCP/IP详解 卷2》 笔记: 简介_tcpip详解卷二有必要看吗-程序员宅基地

- 饺子播放器Jzvd使用过程中遇到的问题汇总-程序员宅基地

- python- flask current_app详解,与 current_app._get_current_object()的区别以及异步发送邮件实例-程序员宅基地

- 堪比ps的mac修图软件 Pixelmator Pro 2.0.6中文版 支持Silicon M1_pixelmator堆栈-程序员宅基地

- 「USACO2015」 最大流 - 树上差分_usaco 差分-程序员宅基地

- Leetcode #315: 计算右侧小于当前元素的个数_找元素右边比他小的数字-程序员宅基地

- HTTP图解读书笔记(第六章 HTTP首部)响应首部字段_web响应的首部内容-程序员宅基地