深度学习之损失函数的介绍

”loss计算“ 的搜索结果

主要介绍基于pytorch实现交叉熵损失,L1Loss,L2Loss和smooth L1损失

针对窗函数造成的信噪比损失的计算,有问题的可以联系我

损失在网络的用法

在本片文章里小编给大家整理的是关于Pytorch中accuracy和loss的计算相关知识点内容,有需要的朋友们可以学习下。

YOLOv3 Loss计算和正负样本选取

anchor 是一类目标检测方法种的一个核心概念,其本质是一个预设的框,但是这个框也为 loss 计算带来一些麻烦。 对于一般的目标检测 loss 计算,通常分为几部分。比如 yolo 系列分为 objectness(是否包含目标)、...

YOLOV5源码解读系列文章目录 数据集加载和增强 前言 此篇为yolov5 3.1 版本,官方地址[https://github.com/ultralytics/yolov5] 看源代码之前有必要先大致了解实现... 创建数据加载器,由utils/datasets.py的crea

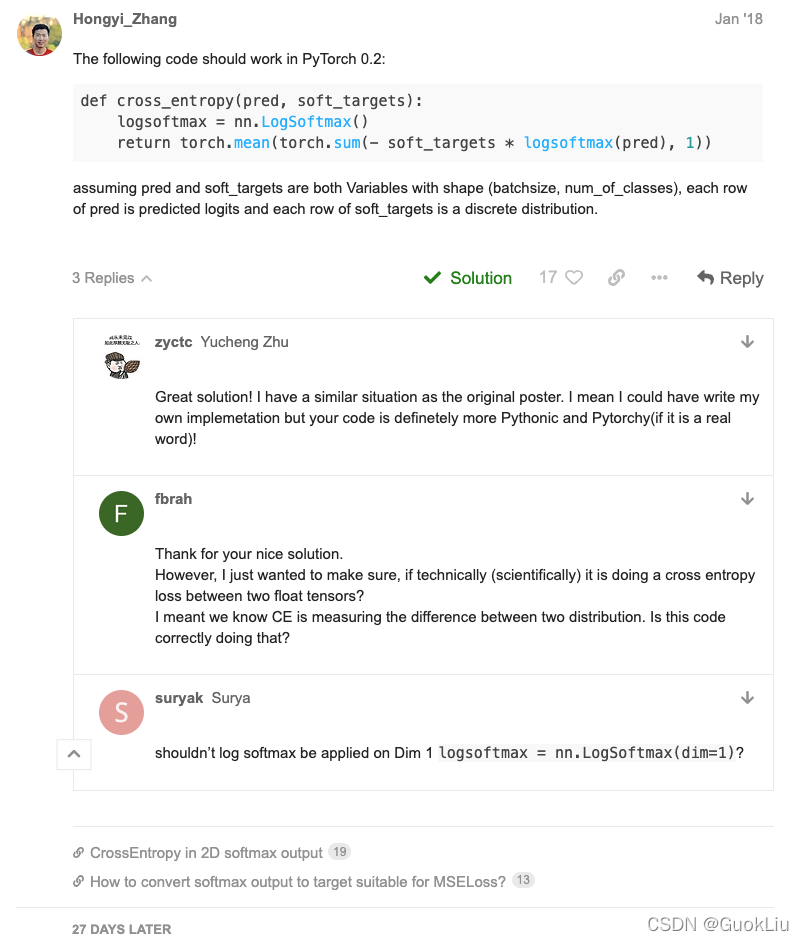

NLLLoss & CrossEntropyLoss crossentropyloss = softmax + log + nllloss L=−1N∑ipilgqi L=-\frac{1}{N}\sum_i{p_i\lg q_i} L=−N1i∑pilgqi pip_ipi 真实label qiq_iqi 预测lable概率 def...

1 stack_hourglass ...由于stackhourglass是采用的annotation为h5格式文件,所以直接在计算loss时是采用的 error = np.linalg.norm(p[0]['keypoints'][j, :2]-g[0, j, :2]) / normalize 2 HRNet

浅谈yolov4中小技巧--回归loss计算ciou前言目标检测loss的发展史什么是Smooth L1 Loss 前言 今天我们来看下目标检测里面提出的CIOU。 目标检测loss的发展史 在目标检测中其演进路线是Smooth L1 Loss --> IoU Loss...

错误提示: RuntimeError: Expected to have finished reduction in the prior ...at your module has parameters that were not used in producing loss. You can enable unused parameter detection by (1) passin g

假设我们的数据集有三个样本,三个特征分别是 ...在pytorch.nn.MSEloss中,计算的顺序是这样的 1_loss = (0.3-0)^2 + (0.3-0)^2 + (0.4-1)^2 = 0.54 2_loss = (0.3-0)^2 + (0.4-1)^2 + (0.2-0)^2 = 0.54 3_los

【深度学习】softmax loss 计算

【深度学习】smooth L1 loss 计算

针对二分类问题,最后一层的输出可以采用不同的设置方式,关键是取决于目标值y_target的数据处理形式。 目录目标输出 (0 or 1)方案一方案二from_logits设置结果比较方案一方案二无概率处理结果目标输出 one_hot ...

#生成anchoranchors=self.anchor_generator(features)#如果是训练,则结合ground_truth计算lossifself.training可以看到无论是训练过程,还是预测过程,都使用到了生成的anchor。那么我们就先深入了解一下训练的...

标签分配:GT的中心落在哪个grid,那个grid对应的两个bbox中与GT的IOU最大的bbox为正样本,其余为负样本,(由于是回归模型,不是分类模型,其解决类别不平衡的方式为各项loss采取不同的权重),即虽然一个grid分配...

而梯度和loss值是分不开的,选择好合适的loss计算方法也是有助于训练好优秀的网络模型的。常用的loss计算方法有两种,一个是均方差,另一个是交叉熵。均方差差不多是万金油,什么都可以套一套,通常与sigmoid激活...

YOLO中LOSS函数的计算代码解读无目标位置confidence的delta:0 - l.output[obj_index]有目标位置confidence的delta:1 - l.output[obj_index]有目标位置坐标(x,y,w,h)的delta有目标位置class的delta代码分析和公式...

推荐文章

- LAMP 架构深度优化-程序员宅基地

- python3.7.3+cuda9.2安装pytorch_python官网cuda9.2-程序员宅基地

- 【Springboot】基础业务学习笔记-程序员宅基地

- macbook 的 charles 使用-程序员宅基地

- 2023最新Android Studio安装、卸载、解决c盘占用教程_build configuration language-程序员宅基地

- 【论文精读】Temporally Refined Graph U-Nets for Human Shape and Pose Estimation From Monocular Videos-程序员宅基地

- ubuntu 安装完oracle之后没有sqlplus,Linux安装Oracle成功后,启动sqlplus问题集合(详解)...-程序员宅基地

- elasticsearch-setup-passwords interactive_bash: elasticsearch-setup-passwords: command not f-程序员宅基地

- 学校公共计算机保用规定,湖南中医药大学涉密计算机和涉密移动存储介质保密管理规定...-程序员宅基地

- Vue.js复习_下列代码中,应用v-for指令遍历数组items-程序员宅基地