”batch“ 的搜索结果

之前介绍过了,把训练数据分为很多个batch,然后每个batch算梯度并更新,所有batch全部计算过一次为一个,在一个echo完成后下一个echo前,需要先进行(洗牌,打乱次序),即再次将训练数据重新分配,与之前的分配...

【深度学习】神经网络中 Batch 和 Epoch 之间的区别是什么?我们该如何理解?

批处理(Batch),也称为批处理脚本,它的本质,是一堆DOS命令按一定顺序排列而形成的集合,通常被认为是一种简化的脚本语言。由于Windows操作系统的绝对市场地位,Batch被广泛应用于我们平时的工作,来代替人工处理...

1,epochs,batch,iterations 1,epochs 1个epoch等于使用全部训练数据训练一次,也可以说1个epoch是整个输入数据的单次向前和向后传递。 epoch的值就是同样的一个全部训练数据集被重复用几次来训练,亦即应当...

批处理(Batch)就是对某对象进行批量的处理,本篇文章给大家介绍一下Batch的基本概念、Batch的特点和导致Draw call性能开销的主要原因。 什么是Batch Batch翻译成中文一般我们称之为“批次”。我们经常用引擎每...

Spring Batch 作为 Spring 的子项目,是一款基于 Spring 的企业批处理框架。通过它可以构建出健壮的企业批处理应用。Spring Batch 不仅提供了统一的读写接口、丰富的任务处理方式、灵活的事务管理及并发处理,同时还...

Spring Batch是一个基于Java的开源批处理框架,用于处理大规模、重复性和高可靠性的任务。它提供了一种简单而强大的方式来处理批处理作业,如数据导入/导出、报表生成、批量处理等。什么是Spring Batch?Spring ...

本文介绍了1个示例,即通过spring boot 启动spring batch的任务,该任务是通过注解实现的。文件位置:/sping-batch/src/main/resources/student-data.txt。本文使用的是jdk8版本,最新版本的spring core和springb ...

本篇博客总结几种归一化办法,并给出相应计算...1、Batch Normalization https://arxiv.org/pdf/1502.03167.pdf 2、Layer Normalizaiton https://arxiv.org/pdf/1607.06450v1.pdf 3、Instance Normalization h...

Batch一般被翻译为批量,设置batch_size的目的让模型在训练过程中每次选择批量的数据来进行处理。Batch Size的直观理解就是一次训练所选取的样本数。 Batch Size的大小影响模型的优化程度和速度。同时其直接影响到...

深度学习中经常看到epoch、 iteration和batchsize,下面按自己的理解说说这三个的区别: (1)batchsize:批大小。在深度学习中,一般采用SGD训练,即每次训练在训练集中取batchsize个样本训练; (2)iteration:...

单层视角 神经网络可以看成是上图形式,对于中间的某一层,其前面的层可以看成是对输入的处理,后面的层可以看成是损失函数。一次反向传播过程会同时更新所有层的权重W1,W2,…,WL,前面层权重的更新会改变当前层输入...

epoch、batch、batchsize理解

padded_batch(batch_size, padded_shapes=None, padding_values=None, drop_remainder=False,name=None) 该函数可以将数据集的连续元素合并到padded batch中。即将输入数据集的多个连续元素合并到单个元素中。 tf....

文件位置:/sping-batch/src/main/resources/spring-batch-context4.xml。文件位置:/sping-batch/src/main/resources/spring-batch-context5.xml。文件位置:/sping-batch/src/main/resources/context-datasource2....

batch normalization 和 layer normalization 在RNN(LSTM、GRU)上的TensorFlow实现;运行无误,示例为mnist手写体识别

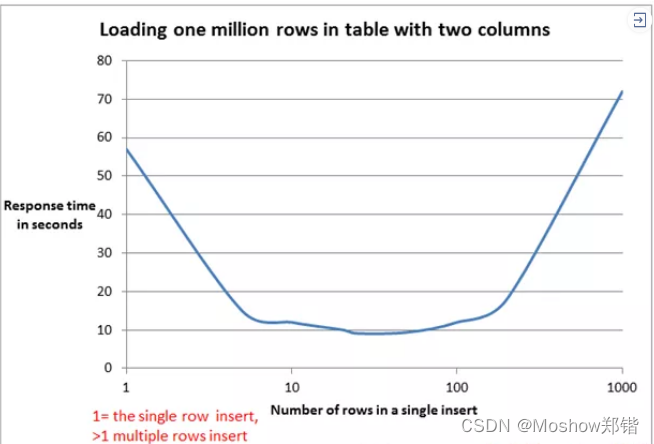

batch size的大小影响的是训练过程中的完成每个epoch所需的时间和每次迭代(iteration)之间梯度的平滑程度。在不限内存的情况,应当用大点的batch_size, 进行模型优化,稳且快。在内存有限的情况下,减小batch_size的...

近年来深度学习捷报连连,声名鹊起,随机梯度下架成了训练深度网络的主流方法。尽管随机梯度下降法,将对于训练深度网络,简单高效,但是它有个毛病,就是需要我们人为的去选择参数,比如学习率、参数初始化等,这些...

推荐文章

- 手写一个SpringMVC框架(有助于理解springMVC) 侵立删_springmvc可以用来写安卓后端吗-程序员宅基地

- 线性判别分析LDA((公式推导+举例应用))_lda推导-程序员宅基地

- C# 结构体(Struct)精讲_c# struct-程序员宅基地

- 支付宝Wap支付你了解多少?_阿里wap支付-程序员宅基地

- Java计算器编写,实现循环输入_java简易计算器可使用户多次输入-程序员宅基地

- 【多维Dij+DP】牛客小白月赛75 D-程序员宅基地

- Android之内存优化与OOM-程序员宅基地

- Azure Machine Learning - 视频AI技术_azure ai 視頻索引器-程序员宅基地

- 个人知识管理软件使用感受-程序员宅基地

- WWDC2019 ------深入理解App启动_wwdc app启动-程序员宅基地