文章目录一、Encoder-Decoder(编码-解码)介绍几点说明信息丢失的问题应用二、Seq2Seq(序列到序列)介绍Seq2Seq与Encoder-Decoder代码实现 一、Encoder-Decoder(编码-解码) 介绍 Encoder-Decoder是一个模型构架...

”Encoder-Decoder“ 的搜索结果

Encoder-Decoder算法是一种深度学习模型结构,广泛应用于自然语言处理(NLP)、图像处理、语音识别等领域。它主要由两部分组成:编码器(Encoder)和解码器(Decoder)。如图1所示,这种结构能够处理序列到序列(Seq...

编码-解码器-lstm 使用keras,numpy和panda的LSTM模型进行序列到序列的预测。 笔记 该项目是使用PyScaffold 3.0.3设置的。 有关PyScaffold的详细信息和使用信息,请参见 。

本文将从Encoder-Decoder的本质、Encoder-Decoder的原理、Encoder-Decoder的应用三个方面,带您一文搞懂Encoder-Decoder(编码器-解码器)。

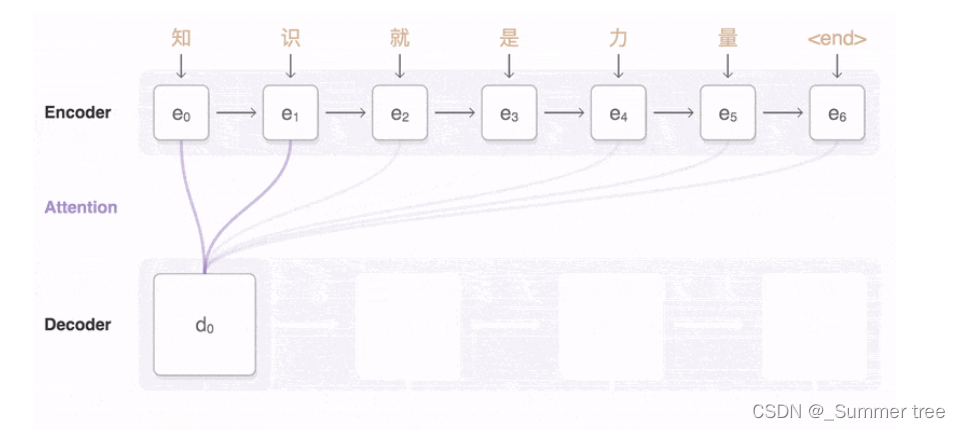

通过计算Decoder的隐藏状态与Encoder输出的每个词的隐藏状态的相似度(Score),进而得到每个词的Attention Weight,再将这些Weight与Encoder的隐藏状态加权求和,生成一个Context Vector。1)编码器(Encoder):...

Encoder-Decoder通常称作编码器-解码器,是深度学习中常见的框架。很多常见的应用都是利用编码-解码框架设计的。Encoder-Decoder框架很好地诠释了机器学习的核心思路:将现实问题转换为数学问题,通过求解数学问题...

jpeg压缩的matlab代码

编码器 图像分割需要“ U” /编码器-解码器网络有哪些功能? 编码器-解码器网络 自动编码器 带有快捷方式的自动编码器 具有两个解码器的自动编码器 baseline: UNet 具有两个解码器的UNet UNet 2+ /(已修改)...

cd Line-Encoder-Decoder 安装要求 pip3 install -r requirements.txt 运行服务器 python manage.py runserver 此项目的工作演示可在 即将发生的变化 改善使用者介面 使用PlotDigitiser实现解码部分。

SegNet: A Deep Convolutional Encoder-Decoder Architecture for Scene Segmentation

简单了解Encoder-Decoder和AE

总而言之,个人认为 huggingface目前的模型接口,对于decoder-only模型的使用并不是很友好。在使用过程中需要注意很多细节,不然会遇到许多问题,而这些问题,encoder-decoder模型是完全不会有的。

python实现基于Encoder-Decoder架构的神经网络公式识别源码+PPT文档(高分大作业).zip该项目是个人大作业项目源码,评审分达到95分以上,都经过严格调试,确保可以运行!放心下载使用。 python实现基于Encoder-...

基于强化学习的编码器,解码器的实现 论文“基于增强学习的编码器-解码器框架,用于学习股票交易规则”的实施 系统架构

SegNet: A Deep Convolutional Encoder-Decoder Architecture for Image Segmentation

码器-解码器(encoder-decoder):传统 Transformer 模型是建立在编码器-解码器架构上的 ,由两个 Transformer 块分别作为编码器和解码器。编码器采用堆叠的多头自注意层对输入序列进行编码以生成其潜在表示,而解码...

根据 Encoder 的隐藏状态迭代生成组成输出序列的 token。输入文本被 tokenized 成 token embedding。由于注意力机制不知道 token 的相对位置,因此我们需要一种方法将一些有关 token 位置的信息注入到输入中,以对...

Encoder-Decoder 是一种架构,范围非常广泛,只要是用一个编码结构一个解码结构的模型都是Encoder-Decoder 架构 seq2seq 和 Encoder-Decoder基本相同,只不过后者是一种抽象概念,前者是具体的模型,seq2seq可以...

前缀语言模型可以根据给定的前缀生成后续的文本,而因果语言模型只能根据之前的文本生成后续的文本。在模型架构代表LLM注意力机制是否属于Decoder-Only纯单向YESFlan-T5输入双向NO输入双向,输出单向YES。

Learning Phrase Representations using RNN Encoder–Decoder for Statistical Machine Translation

Decoder-Only架构专注于从一系列输入生成或预测输出。这种架构通常用于文本生成任务,如语言模型。Encoder-Decoder架构结合了编码器和解码器的优点,通常用于需要理解输入并生成相应输出的任务,如机器翻译。

机器翻译是序列转换模型的一个核心问题, 其输入和输出都是长度可变... 这被称为编码器-解码器(encoder-decoder)架构,如下图所示。 以英语到法语的机器翻译为例: 给定一个英文的输入序列:“They”、“are”、“wat

本文介绍了Encoder-Decoder CNN模型的理论原理、优缺点,并通过Python代码实现了Encoder-Decoder CNN模型进行单步预测和多步预测。Encoder-Decoder CNN模型是一种利用卷积神经网络的端到端序列预测模型,对其的改进...

推荐文章

- 阿里云企业邮箱的stmp服务器地址_阿里云stmp地址-程序员宅基地

- c++ 判断数学表达式有效性_高考数学大题如何"保分"?学霸教你六大绝招!...-程序员宅基地

- 处理office365登录出现服务器问题_o365登陆显示网络异常-程序员宅基地

- Nginx RTMP源码分析--ngx_rtmp_live_module源码分析之添加stream_ngx_rtmp_live_module 原理-程序员宅基地

- 基于Ansible+Python开发运维巡检工具_automation_inspector.tar.gz-程序员宅基地

- Linux Shell - if 语句和判断表达式_shell if elif-程序员宅基地

- python升序和降序排序_Python排序列表数组方法–通过示例解释升序和降序-程序员宅基地

- jenkins 构建前执行shell_Jenkins – 在构建之前执行脚本,然后让用户确认构建-程序员宅基地

- 如何完全卸载MySQL_mysql怎么卸载干净-程序员宅基地

- AndroidO Treble架构下HIDL服务查询过程_found dead hwbinder service-程序员宅基地